No importa donde estés, es probable que el año que viene te escaneen la cara para medir tus niveles de agresión. NtechLab, una empresa de reconocimiento facial rusa conocida por la aplicación FindFace, a la que acusaron de terminar con la privacidad online, informó que está probando una tecnología de “detección de agresiones” y planea lanzarla para sus socios y clientes en 2021.

Para eso, acaba de recibir US$ 15 millones de dos fondos soberanos, el Fondo de Inversión Directa de Rusia y un misterioso socio anónimo de Medio Oriente. NtechLab ya había recibido financiación de Mubadala Investment Company, la inversora de Emiratos Árabes Unidos, pero se negó a revelarle a Forbes quién puso dinero en esta nueva ronda. Con los fondos, la startup abrirá una oficina en Latinoamérica y planifica otra en Medio Oriente e incluso instalar su sede en Asia. “Nuestra principal ventaja es que nuestra solución se puede escalar para ciudades de cualquier tamaño”, afirma Alexander Kabakov, cofundador de NtechLab, quien agrega que la solución puede trabajar con cientos de miles de cámaras por toda una metrópolis.

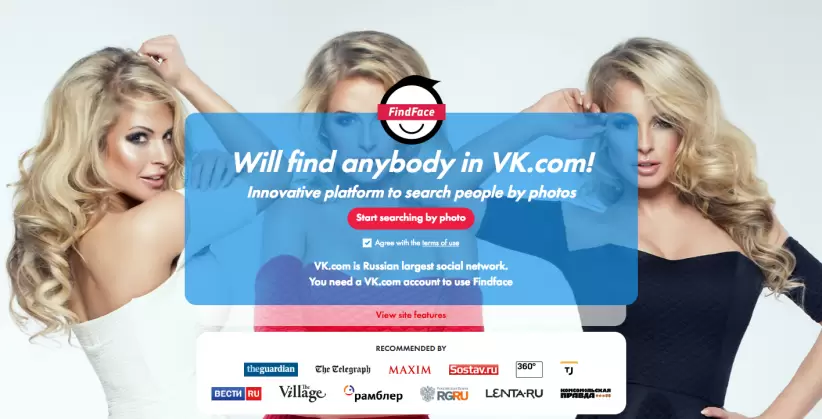

En 2016, NtechLab causó polémica cuando lanzó FindFace con la promesa de poder capturar cualquier imagen de un rostro y vincularla con perfiles en la red social rusa Vkontakte (VK). Después, la empresa se transformó en proveedora de vigilancia, sobre todo en Moscú, donde sus algoritmos forman la base de un gigantesco proyecto de vigilancia mediante el reconocimiento facial. Según Kabakov, en los primeros diez días de enero, el sistema en Moscú ayudó a atrapar 34 “delincuentes”, pero no pudo decir a cuántos se enjuició.

El reconocimiento facial ya era una tecnología polémica, tildada no solo de dañina para la privacidad individual, sino también posiblemente racista, ya que algunos algoritmos califican a las personas afroamericanas como más sospechosas que las blancas. Además, la detección de agresiones y emociones es ética y técnicamente cuestionable. En un estudio de Lauren Rhue, de la Universidad de Maryland, se probaron herramientas de Microsoft y la empresa china Face++ en jugadores de la NBA. Al verlos sonreír, la IA de Face++ interpretó muchas veces que los jugadores negros estaban más enojados que los blancos. La de Microsoft decidió que los afroamericanos eran más “desdeñosos” cuando las expresiones eran ambiguas. Meredith Whittaker, cofundadora del instituto de investigación AI Now y fundadora del Open Research Group de Google, declaró a Forbes que “la idea de que se pueden detectar las características internas y sentimientos de alguien de forma regular y universal en sus cualidades físicas o sus actos no está demostrada, en el mejor de los casos, y lo que afirman poder hacer esos sistemas no está validado”.

Caras de furia

Quizás sea por eso que NtechLab no se está apurando. Uno de sus cofundadores, Artem Kukharenko, observó que la empresa debe estar “100% segura” antes de lanzar el producto. NtechLab aclaró que su detección de agresiones se encuentra en una “etapa inicial de desarrollo”, por lo cual no puede aportar datos sobre su exactitud. “Esto es muy complejo porque incorpora la detección de siluetas, actos y emociones. Nuestro algoritmo actual para siluetas y rostros es muy exacto. Para incorporar la detección de actos se necesita más investigación y desarrollo”, afirmó la empresa en un comunicado. “Queremos presentarlo al público el año que viene”.

La tecnología de “seguimiento de siluetas” de Ntech, que analiza los patrones de sombra únicos que proyecta la cara de una persona, ya se usa y sirve para cuando no se puede ver bien la cara del objetivo. También se puede activar la “detección de violencia” si una cámara filma a individuos actuando de manera violenta. Sumando a esto el reconocimiento de vehículos, las fuerzas de seguridad pueden rastrear a un individuo que se comporte de manera violenta por toda una ciudad aunque tenga cubierto el rostro, afirmó Kabalov.

Kabalov agregó que fuera de Moscú, la empresa tiene clientes en Argentina, Brasil y Serbia. Es poco probable que su nueva tecnología se use en EE.UU. o Reino Unido porque NtechLab es rusa, admite. Aspectos éticos aparte, las empresas que ofrezcan herramientas parecidas no tendrán los mismos problemas si no vienen de Rusia.

Autor: Thomas Brewster

Podés leer la nota completa en inglés acá